راه پرداخت/ در جنگ، سرعت ميکُشد. سربازي که در کشيدن کمان از سرعت بيشتري برخوردار باشد، ميتواند جان سالم از مهلکه به در ببرد؛ کشتي که زودتر کشتي دشمن را غرق ميکند، ميتواند خود را از باران موشک برهاند. در مواردي که انسانها نميتوانند با سرعت جنگهاي مدرن پيش بروند، ماشينها وارد ميدان ميشوند. زماني که يک آرپيجي به يک خودروي زرهي شليک ميشود، يک سيستم خودکار روي خودرو اين تهديد را شناسايي کرده، آن را رديابي کرده و يک گلوله به سمت آن شليک ميکند تا آن را متوقف کند و همه اين اقدامات قبل از آني اتفاق ميافتد که خدمه داخل خودرو از آن مطلع شوند.

بهطور مشابه، کشتيهاي نيروي دريايي ايالات متحده به سيستم حفاظتي رزمي مجهز هستند که ميتواند حالت خودکار ويژه را فعال کند که بهطور خودکار و بر اساس قواعد برنامهريزيشده دقيق، موشکهاي شليکشده به سمت کشتي را مورد اصابت قرار ميدهد.

اين نوع از سيستمهاي دفاعي، دههها به کار گرفته شدهاند و در حال حاضر هم حداقل ۳۰ کشور از آن استفاده ميکنند. از بسياري جهات آنها مشابه سيستمهاي ترمز خودکار در خودروهاي جديد هستند که تنها در شرايط اضطراري فعال ميشوند، اما نظاميان هم، مانند خودروسازان، بهتدريج آزادي عمل ماشينها را بيشتر کردهاند.

در يک رزمايش در سال گذشته، ايالات متحده نشان داد که اتوماسيون چگونه ميتواند در يک اصطلاحاً «زنجير کشتار» به کار گرفته شود؛ يک ماهواره، کشتي دشمن فرضي را هدفگيري کرد و يک هواپيماي تجسس را براي پرواز نزديکتر به کشتي و تأييد شناسايي، اعزام کرد؛ هواپيماي تجسس سپس دادههاي خود را به يک هواپيماي فرماندهي و کنترل هوابرد ارسال کرد و اين هواپيما، يک ناوشکن دريايي را براي انجام حمله انتخاب کرد. در اين سناريو، اتوماسيون فرصت بيشتري را در اختيار افسران قرار داد تا يک تصميم آگاهانه اتخاذ کنند؛ اينکه آيا به کشتي دشمن شليک کنند يا خير.

نيروهاي نظامي يک دليل الزامآور براي مشارکت انسان در تصميمات مهم و مهلک دارند. يکي اينکه، انسانها بهعنوان محافظي در برابر عملکردهاي نادرست و تفسيرهاي نادرست از دادهها عمل ميکنند؛ آنها قبل از اينکه ماشه را بکشند اطمينان حاصل ميکنند که سيستم خودکار، يک کشتي خودي يا يک کشتي بيطرف را به اشتباه بهعنوان کشتي دشمن شناسايي نکرده باشد.

علاوه بر اين، حتي پيشرفتهترين انواع هوش مصنوعي هم نميتوانند بافت و زمينه را درک کنند، قضاوت کرده، يا در شرايط جديد مانند يک انسان واکنش نشان دهند. انسانها از همه بهتر ميتوانند وارد فکر فرمانده دشمن شوند، عملياتهاي دروغين و تظاهري را تشخيص دهند و اينکه چه زماني عنصر غافلگيري را به کار گرفته و چه زماني حمله کنند.

اما ماشينها، سريعتر هستند و کسي که اول حمله ميکند، مزاياي زيادي را از آن خود ميکند. با توجه به اين فشار رقابتي، نميتوان تصور روزي را دور از ذهن دانست که تنها راه زندهماندن، استفاده از يک زنجير کشتار کاملاً خودکار باشد. اگر تنها يک ابرقدرت اين کار را انجام دهد، سايرين ممکن است خود را مجبور به پيروي از اين ابرقدرت احساس کنند. در سال ۲۰۱۶، «رابرت ورک»، وزير دفاع وقت، اين مسئله بغرنج را به زبان ساده بدين صورت بيان کرد:

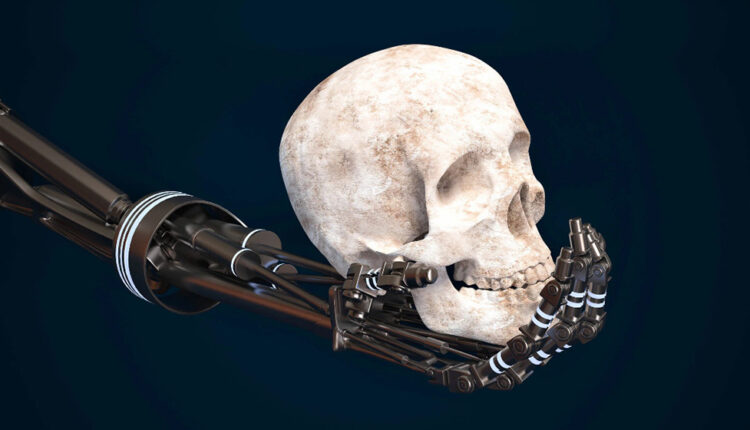

او پرسيد: «اگر رقباي ما به سمت ترميناتورها بروند و مشخص شود که ترميناتورها قادر به تصميمگيري سريعتر هستند، حتي اگر آنها بد باشند، ما چگونه بايد واکنش نشان دهيم؟»

ترميناتورها هنوز از خط مونتاژ خارج نشدهاند، اما هر نسل جديدي از تسليحات در حال نزديکشدن به انسانهاست. در حالي که هيچ کشوري هنوز قصد خود براي ساخت تسليحات کاملاً خودمختار و مستقل را اعلام نکرده، اما تعداد اندکي هم آن را تکذيب کردهاند. خطرات يک جنگافزار با سرعت ماشين، بسيار بيشتر از صرفاً يک موشک تمامعيار است. محققان نظامي در چين در مورد يک «شگفتي در ميدان جنگ» گمانهزني کردهاند؛ نقطهاي که در آن، نبرد سريعتر از درک بشر به پيش ميرود. در شرايط «فراجنگ»، آنطور که برخي استراتژيستهاي جنگي آمريکايي آن را ناميدهاند، افزايش ناخواسته شدت جنگ ميتواند سريعاً از کنترل خارج شود.

سقوط ناگهاني در بازار سهام در سال ۲۰۱۰، يک نمونه متناظر از اين شرايط است: الگوريتمهاي خودکار تجارت، به زيان موقت چند تريليون دلاري در يک روز عصر منجر شدند. براي جلوگيري از چنين فاجعهاي، تنظيمگران مالي مکانيسم توقف معاملات را بهروز کردند؛ به گونهاي که اين مکانيسم در صورت افت بسيار سريع قيمتها، معاملات را متوقف ميکند، اما شما چگونه ميتوانيد مانع يک جنگ ناگهاني شويد؟

از اواخر قرن نوزدهم، ابرقدرتهاي نظامي ـ چه بريتانياي کبير و آلمان و چه ايالات متحده و اتحاد جماهير شوروي سابق ـ براي ايجاد قواعدي در مورد انواع ماشينهاي کشتار نوين، از گلولههاي انفجاري تا گازهاي سمي و تسليحات اتمي، تلاش کردهاند. در برخي موارد مانند تسليحات ضدماهواره و بمبهاي نوتروني، توافقات رسمي ضروري نبود؛ طرفين بهسادگي محدوديتهاي ضمني اعمال کردند. در تمام اين موارد، هدف، کاهش اثرات و عواقب جنگ بود.

در حال حاضر، چنين اجماعي در مورد تسليحات کاملاً خودمختار وجود ندارد. تقريباً ۳۰ کشور از ممنوعيت کامل حمايت ميکنند، اما هيچيک از آنها ابرقدرت نظامي يا توسعهدهنده رباتيک نيستند. در سازمان ملل متحد، زماني که موضوع تسليحات خودمختار مورد بحث سالانه بود، چين، روسيه و ايالات متحده، تلاشها براي تصويب ممنوعيت را خنثي کردند (ايالات متحده و روسيه بهوضوح و مستقيماً مخالفت نکردند، در حالي که چين در سال ۲۰۱۸ ممنوعيتي را پيشنهاد داد که در واقع بيهوده بود). يکي از سازوکارهاي چالشبرانگيز در سازمان ملل، زورآزمايي بين سازمانهاي غيردولتي ـ همچون پويش توقف رباتهاي قاتل که هدف آن خلع سلاح است ـ و ارتشهاي نظامي است که تن به خلع سلاح نميدهند؛ مگر اينکه مطمئن شوند که رقباي آنها نيز اين کار را ميکنند.

تسليحات خودمختار چالشهاي منحصربهفردي را براي قانونگذاران و تنظيمگران ايجاد ميکند. آنها را نميتوان به مانند مثلاً يک موشک هستهاي ۱.۵ مگاتني مشاهده و سنجش کرد. واقعاً عامل خودمختاري چيست و چه ميزان از آن را بايد مجاز دانست؟ چگونه ميتوانيد يک هواپيماي بدون سرنشين کنترل از راه دور دشمن را از يک هواپيماي مجهز به نرمافزار ترميناتور تشخيص دهيد؟ پيشروي اتوماسيون ادامه خواهد داشت، مگر اينکه تحليلگران امنيتي بتوانند پاسخهاي قانعکنندهاي براي اين پرسشهاي پيدا کنند و کشورهاي چين، روسيه و ايالات متحده هم بتوانند در مورد محدوديتهاي مورد توافق چندجانبه تصميم بگيرند. نهايتاً اينکه ابرقدرتهاي دنيا به هر سمتي بروند، ساير کشورها هم به ناچار در همان راه قدم ميگذارند.